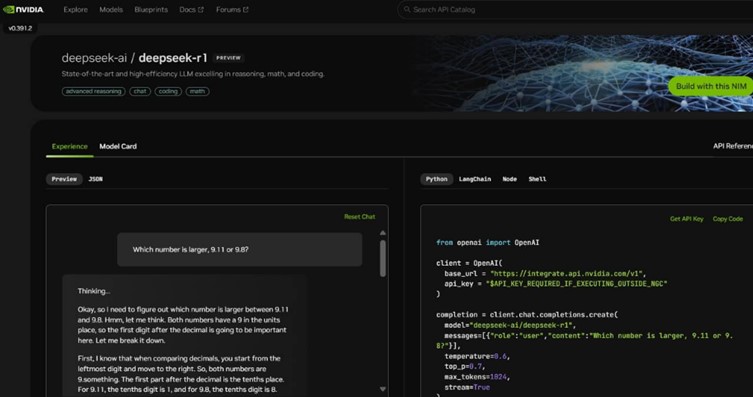

엔비디아가 최첨단 추론 기능을 갖춘 오픈 모델 딥시크-R1(DeepSeek-R1)을 NIM 마이크로서비스에서 지원을 시작한다고 4일 밝혔다.

엔비디아 NIM(NVIDIA NIM, NVIDIA Microservice Infrastructure)은 엔비디아가 자사 그래픽처리장치(GPU)를 구매한 고객들을 대상으로 거대언어모델(LLM) 등의 생성형AI 모델을 쉽게 배포할 수 있도록 돕는 서비스다.

딥시크-R1은 연쇄 사고, 합의, 검색 방법을 거쳐 여러 번의 추론 패스(Inference Passes)를 수행해 최상의 답변을 생성한다. 이같은 방식은 테스트 타임 스케일링(Test-Time Scaling)이라 불리며, AI 모델이 문제를 반복적으로 사고할 수 있도록 해 품질을 올리는 데 기여한다. 특히 논리적 추론, 사고, 수학, 코딩, 언어 이해 등의 복잡한 작업에서 높은 정확도와 효율성을 제공한다. 엔비디아는 NIM 마이크로서비스를 통해 단일 엔비디아 HGX H200 시스템에서 초당 최대 3872개의 토큰을 처리할 수 있도록 지원하고 있다.

딥시크-R1은 6710억개의 파라미터를 통합한 거대 전문가 조합(Mixture-Of-Experts, MoE) 모델로, 최대 12만8000개의 토큰을 처리할 수 있는 광범위한 인풋 컨텍스트 길이(input context length)를 제공한다.각 레이어에는 256명의 전문가가 있다. 하나의 토큰은 병렬로 8명의 전문가에게 라우팅되는 방식으로 최적화된다. 이로 인해 모델의 추론 성능이 극대화되며, 실시간 응답을 제공하기 위해 고성능 GPU 및 NV링크(NVLink) 기반의 통신 시스템이 필수로 요구된다.

현재 딥시크-R1은 엔비디아 AI 엔터프라이즈(AI Enterprise) 소프트웨어 플랫폼의 일부인 NIM 마이크로서비스로 제공되고 있으며, 업계 표준 API를 지원해 배포를 간소화했다. 엔터프라이즈 기업들은 가속 컴퓨팅 인프라를 활용해 보안성과 데이터 프라이버시를 극대화할 수 있다.

또한, 엔비디아 네모(NeMo) 소프트웨어와 AI 파운드리를 이용해 맞춤형 딥시크-R1 NIM 마이크로서비스를 생성할 수 있다.

향후 엔비디아의 블랙웰(Blackwell) 아키텍처가 도입되면, 딥시크-R1의 테스트 타임 확장이 더욱 가속화될 전망이다. 블랙웰 아키텍처는 5세대 텐서 코어(Tensor Core)와 72-GPU NV링크 도메인을 활용해 최대 20페타플롭(FLOPS)의 FP4 연산 성능을 제공함으로써, AI 모델의 추론 속도를 크게 개선할 것으로 예상된다.

개발자들은 엔비디아 빌드 포털(build.nvidia.com)에서 딥시크-R1 NIM 마이크로서비스를 직접 체험할 수 있다. 이를 활용해 에이전틱 AI 시스템에 필요한 높은 효율성을 확보할 수 있다.